X

Код презентации скопируйте его

Информация. Информационные процессы

Скачать эту презентациюПрезентация на тему Информация. Информационные процессы

Скачать эту презентациюCлайд 3

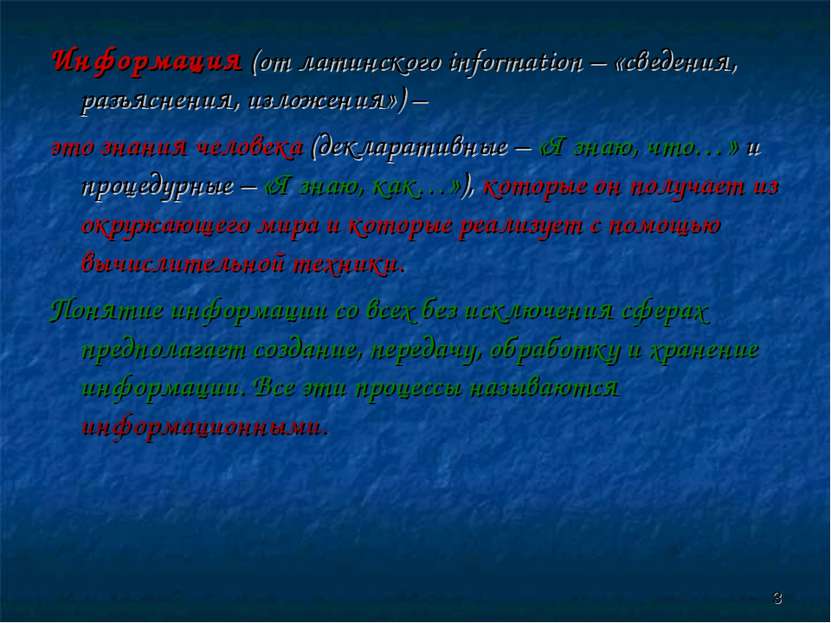

Информация (от латинского information – «сведения, разъяснения, изложения») – это знания человека (декларативные – «Я знаю, что…» и процедурные – «Я знаю, как…»), которые он получает из окружающего мира и которые реализует с помощью вычислительной техники. Понятие информации со всех без исключения сферах предполагает создание, передачу, обработку и хранение информации. Все эти процессы называются информационными. *

Информация (от латинского information – «сведения, разъяснения, изложения») – это знания человека (декларативные – «Я знаю, что…» и процедурные – «Я знаю, как…»), которые он получает из окружающего мира и которые реализует с помощью вычислительной техники. Понятие информации со всех без исключения сферах предполагает создание, передачу, обработку и хранение информации. Все эти процессы называются информационными. *

Cлайд 4

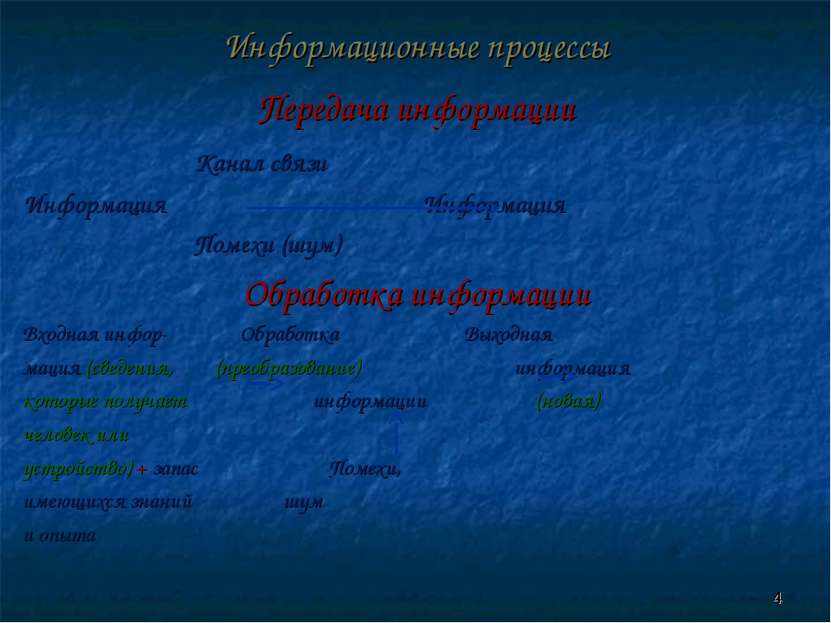

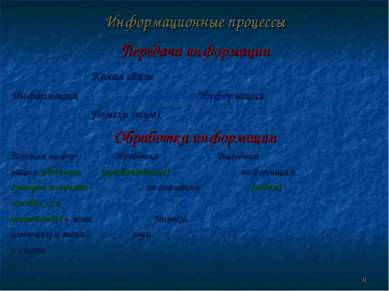

Информационные процессы Передача информации Канал связи Информация Информация Помехи (шум) Обработка информации Входная инфор- Обработка Выходная мация (сведения, (преобразование) информация которые получает информации (новая) человек или устройство) + запас Помехи, имеющихся знаний шум и опыта *

Информационные процессы Передача информации Канал связи Информация Информация Помехи (шум) Обработка информации Входная инфор- Обработка Выходная мация (сведения, (преобразование) информация которые получает информации (новая) человек или устройство) + запас Помехи, имеющихся знаний шум и опыта *

Cлайд 6

Свойства информации Объективность Полнота Актуальность Достоверность Доступность Адекватность *

Свойства информации Объективность Полнота Актуальность Достоверность Доступность Адекватность *

Cлайд 7

Виды информации Информация Аналоговая – Дискретная – непрерывная скачкообразная (воспринимается (воспринимается человеком) вычислительной техникой) Визуальная Аудиальная Тактильная Органолептическая Обонятельная Вкусовая *

Виды информации Информация Аналоговая – Дискретная – непрерывная скачкообразная (воспринимается (воспринимается человеком) вычислительной техникой) Визуальная Аудиальная Тактильная Органолептическая Обонятельная Вкусовая *

Cлайд 8

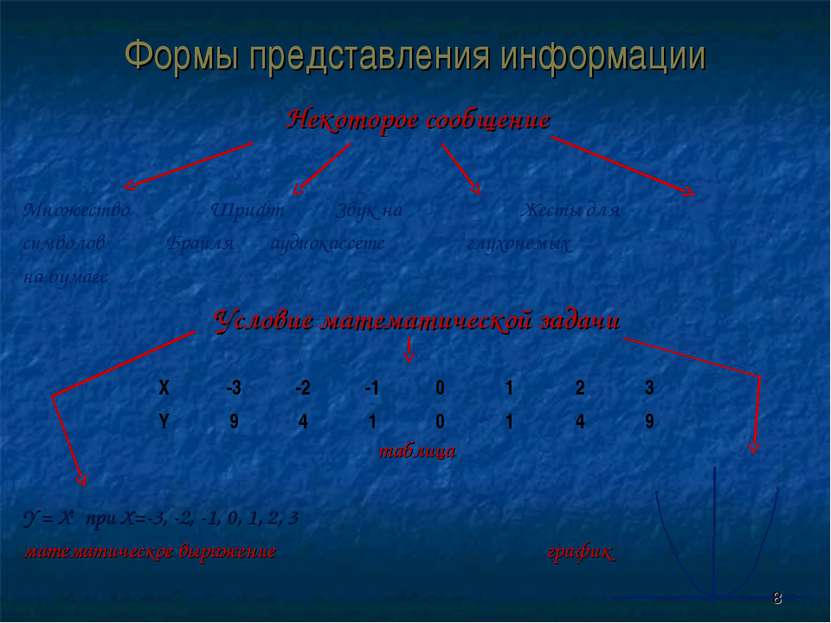

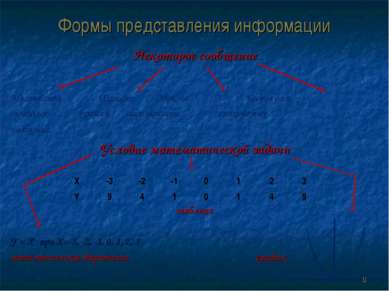

Формы представления информации Некоторое сообщение Множество Шрифт Звук на Жесты для символов Брайля аудиокассете глухонемых на бумаге Условие математической задачи таблица Y = X2 при Х=-3, -2, -1, 0, 1, 2, 3 математическое выражение график * X -3 -2 -1 0 1 2 3 Y 9 4 1 0 1 4 9

Формы представления информации Некоторое сообщение Множество Шрифт Звук на Жесты для символов Брайля аудиокассете глухонемых на бумаге Условие математической задачи таблица Y = X2 при Х=-3, -2, -1, 0, 1, 2, 3 математическое выражение график * X -3 -2 -1 0 1 2 3 Y 9 4 1 0 1 4 9

Cлайд 9

Кодирование информации Код – это система условных знаков для представления информации. Кодирование – это операция преобразования символов или группы символов одного кода в символы или группы символов другого кода. Язык – это знаковая форма представления информации. *

Кодирование информации Код – это система условных знаков для представления информации. Кодирование – это операция преобразования символов или группы символов одного кода в символы или группы символов другого кода. Язык – это знаковая форма представления информации. *

Cлайд 10

Одну и ту же информацию можно кодировать разными способами: КОМПЬЮТЕР – русский язык - - --- -- -- -- - - - Код Морзе COMPUTER – английский язык 67 79 77 80 85 84 69 82 – код ASCII *

Одну и ту же информацию можно кодировать разными способами: КОМПЬЮТЕР – русский язык - - --- -- -- -- - - - Код Морзе COMPUTER – английский язык 67 79 77 80 85 84 69 82 – код ASCII *

Cлайд 11

В процессе обмена информацией кроме кодирования информации происходит и ее декодирование: Пример: как создается новая мелодия Источник информации Кодирующее устройство Передача информации Декодирующ. устройство Получатель информации Образ мело- дии Запись компози- тором мелодии нотами Передача исполнителю носителя с нотами Перевод исполнителем нот в звуки Прослуши-вание мелодии *

В процессе обмена информацией кроме кодирования информации происходит и ее декодирование: Пример: как создается новая мелодия Источник информации Кодирующее устройство Передача информации Декодирующ. устройство Получатель информации Образ мело- дии Запись компози- тором мелодии нотами Передача исполнителю носителя с нотами Перевод исполнителем нот в звуки Прослуши-вание мелодии *

Cлайд 12

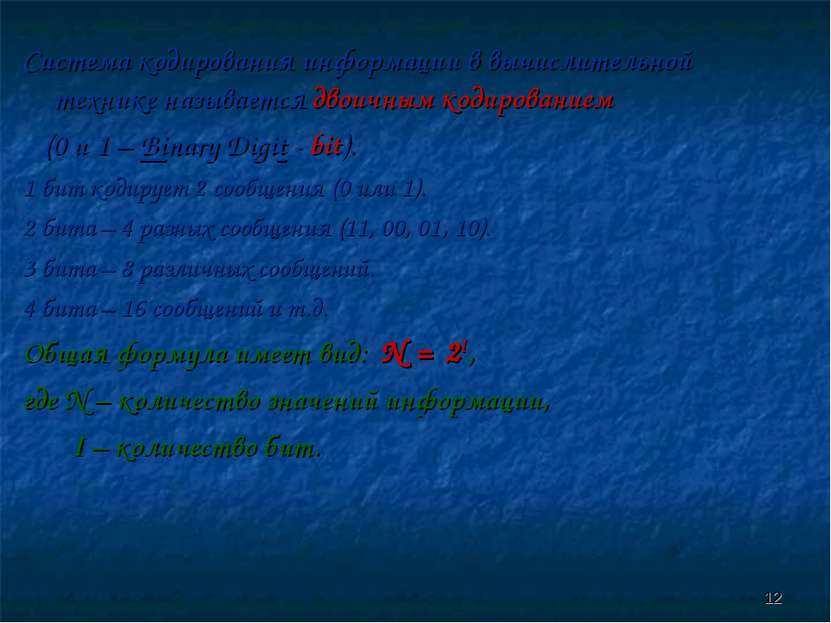

Система кодирования информации в вычислительной технике называется двоичным кодированием (0 и 1 – Binary Digit - bit). 1 бит кодирует 2 сообщения (0 или 1). 2 бита – 4 разных сообщения (11, 00, 01, 10). 3 бита – 8 различных сообщений. 4 бита – 16 сообщений и т.д. Общая формула имеет вид: N = 2I, где N – количество значений информации, I – количество бит. *

Система кодирования информации в вычислительной технике называется двоичным кодированием (0 и 1 – Binary Digit - bit). 1 бит кодирует 2 сообщения (0 или 1). 2 бита – 4 разных сообщения (11, 00, 01, 10). 3 бита – 8 различных сообщений. 4 бита – 16 сообщений и т.д. Общая формула имеет вид: N = 2I, где N – количество значений информации, I – количество бит. *

Cлайд 13

Кодирование текстовой информации Подсчитаем примерное достаточное количество символов и по формуле вычислим необходимое количество бит. 33 русских прописных буквы + 33 русских строчных букв + 26 прописных английских букв + 26 строчных английских букв + 10 цифр + знаки препинания + скобки и знаки математических операций + специальные символы (@, #, $, %...) + знаки псевдографики ≈ 256. Для кодирования такого количества символов достаточно 8 бит или 1 байт. 8 бит = 1 байт. С помощью одного байта можно закодировать 256 различных символов. *

Кодирование текстовой информации Подсчитаем примерное достаточное количество символов и по формуле вычислим необходимое количество бит. 33 русских прописных буквы + 33 русских строчных букв + 26 прописных английских букв + 26 строчных английских букв + 10 цифр + знаки препинания + скобки и знаки математических операций + специальные символы (@, #, $, %...) + знаки псевдографики ≈ 256. Для кодирования такого количества символов достаточно 8 бит или 1 байт. 8 бит = 1 байт. С помощью одного байта можно закодировать 256 различных символов. *

Cлайд 14

Вероятностный подход к определению количества информации (количество информации как мера уменьшения неопределенности знаний) Информация – мера уменьшения неопределенности знаний *

Вероятностный подход к определению количества информации (количество информации как мера уменьшения неопределенности знаний) Информация – мера уменьшения неопределенности знаний *

Cлайд 15

Существует два подхода к измерению информаци: Содержательный: Сообщение несет больше информации, если в нем содержатся новые и понятные сведения. Такое сообщение называется информативным. Количество информации в этом случае зависит от информативности сообщения. *

Существует два подхода к измерению информаци: Содержательный: Сообщение несет больше информации, если в нем содержатся новые и понятные сведения. Такое сообщение называется информативным. Количество информации в этом случае зависит от информативности сообщения. *

Cлайд 16

2. Вероятностный Чем больше начальное число возможных равновероятных событий, тем в большее количество раз уменьшается неопределенность наших знаний, и тем большее количество информации будет содержать сообщение о результатах опыта. Такое количество информации, которое находится в сообщении о том, что произошло одно событие из двух равновероятных, принято за единицу измерения информации и равно 1 биту. 1 бит – это количество информации, уменьша-ющее неопределенность знаний в 2 раза. *

2. Вероятностный Чем больше начальное число возможных равновероятных событий, тем в большее количество раз уменьшается неопределенность наших знаний, и тем большее количество информации будет содержать сообщение о результатах опыта. Такое количество информации, которое находится в сообщении о том, что произошло одно событие из двух равновероятных, принято за единицу измерения информации и равно 1 биту. 1 бит – это количество информации, уменьша-ющее неопределенность знаний в 2 раза. *

Cлайд 17

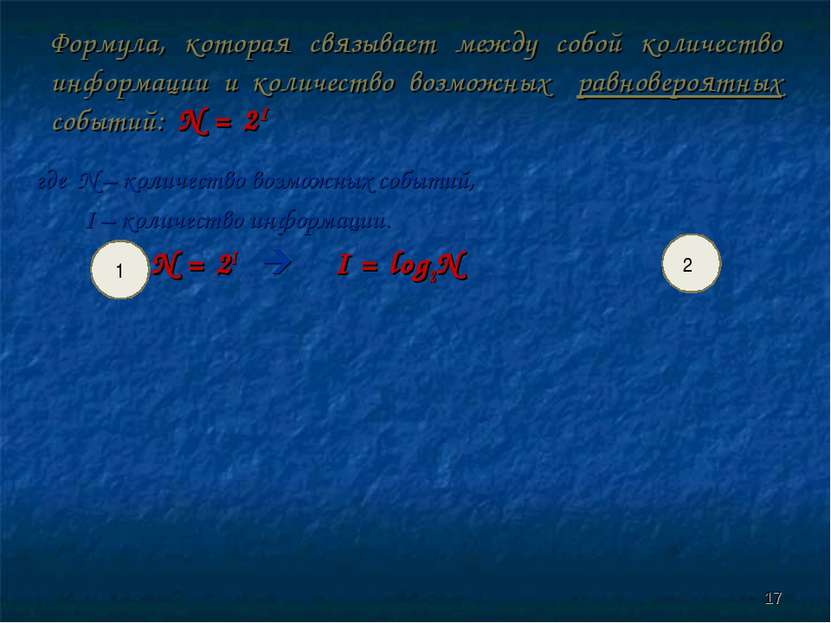

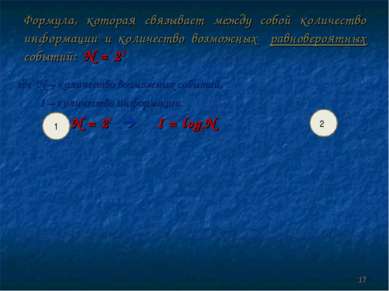

Формула, которая связывает между собой количество информации и количество возможных равновероятных событий: N = 2I где N – количество возможных событий, I – количество информации. N = 2I I = log2N 1 2 *

Формула, которая связывает между собой количество информации и количество возможных равновероятных событий: N = 2I где N – количество возможных событий, I – количество информации. N = 2I I = log2N 1 2 *

Cлайд 18

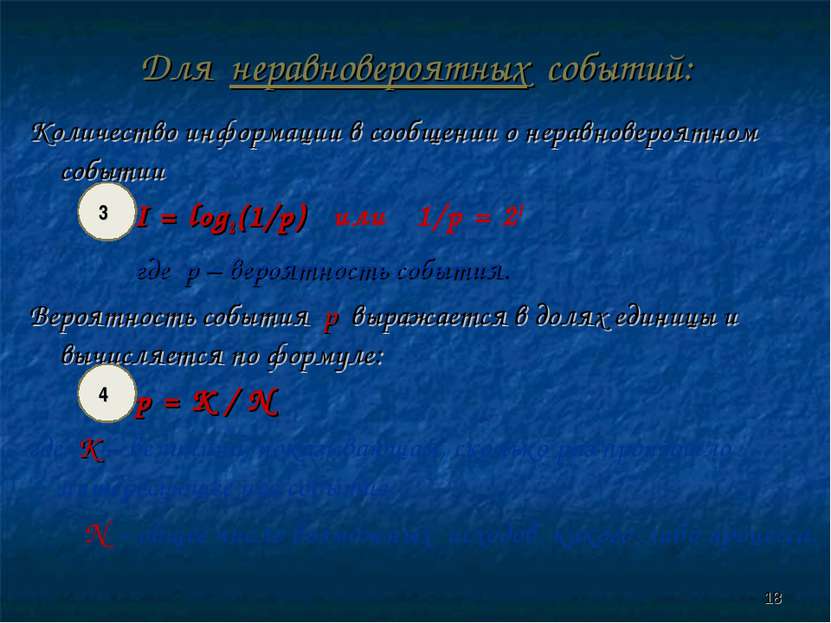

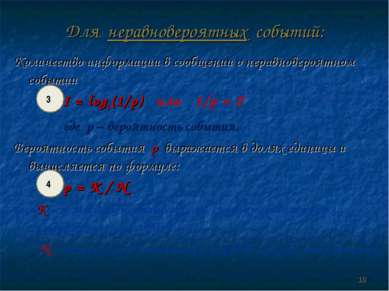

Для неравновероятных событий: Количество информации в сообщении о неравновероятном событии I = log2(1/p) или 1/р = 2I где p – вероятность события. Вероятность события р выражается в долях единицы и вычисляется по формуле: p = K / N где К – величина, показывающая, сколько раз произошло интересующее нас событие, N – общее число возможных исходов какого-либо процесса. 3 4 *

Для неравновероятных событий: Количество информации в сообщении о неравновероятном событии I = log2(1/p) или 1/р = 2I где p – вероятность события. Вероятность события р выражается в долях единицы и вычисляется по формуле: p = K / N где К – величина, показывающая, сколько раз произошло интересующее нас событие, N – общее число возможных исходов какого-либо процесса. 3 4 *

Cлайд 20

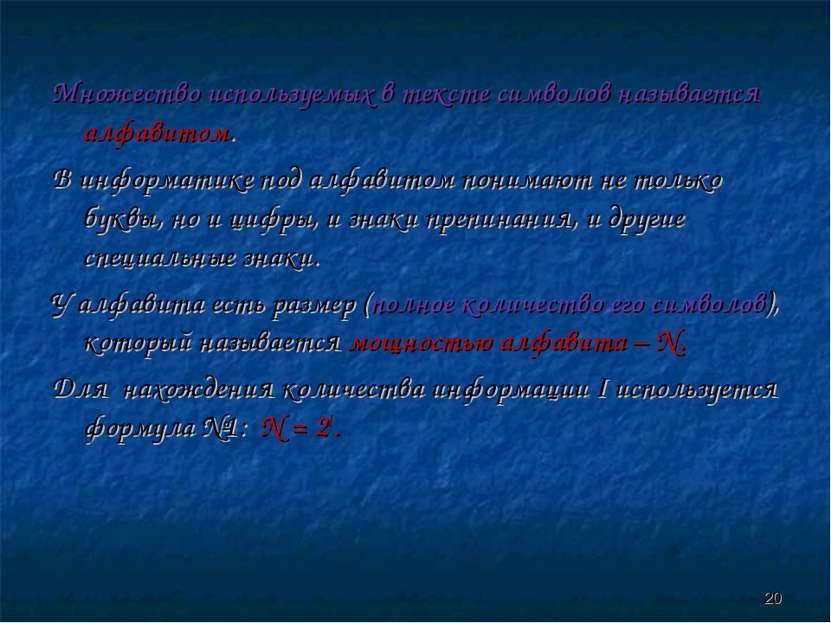

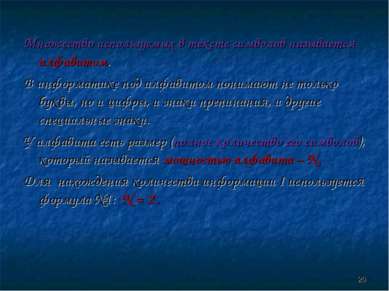

Множество используемых в тексте символов называется алфавитом. В информатике под алфавитом понимают не только буквы, но и цифры, и знаки препинания, и другие специальные знаки. У алфавита есть размер (полное количество его символов), который называется мощностью алфавита – N. Для нахождения количества информации I используется формула №1: N = 2I. *

Множество используемых в тексте символов называется алфавитом. В информатике под алфавитом понимают не только буквы, но и цифры, и знаки препинания, и другие специальные знаки. У алфавита есть размер (полное количество его символов), который называется мощностью алфавита – N. Для нахождения количества информации I используется формула №1: N = 2I. *

Cлайд 21

Задача Найти объем информации, содержащейся в текстах из 3000 символов, написанных русскими и немецкими буквами. (К = 3000) *

Задача Найти объем информации, содержащейся в текстах из 3000 символов, написанных русскими и немецкими буквами. (К = 3000) *

Cлайд 22

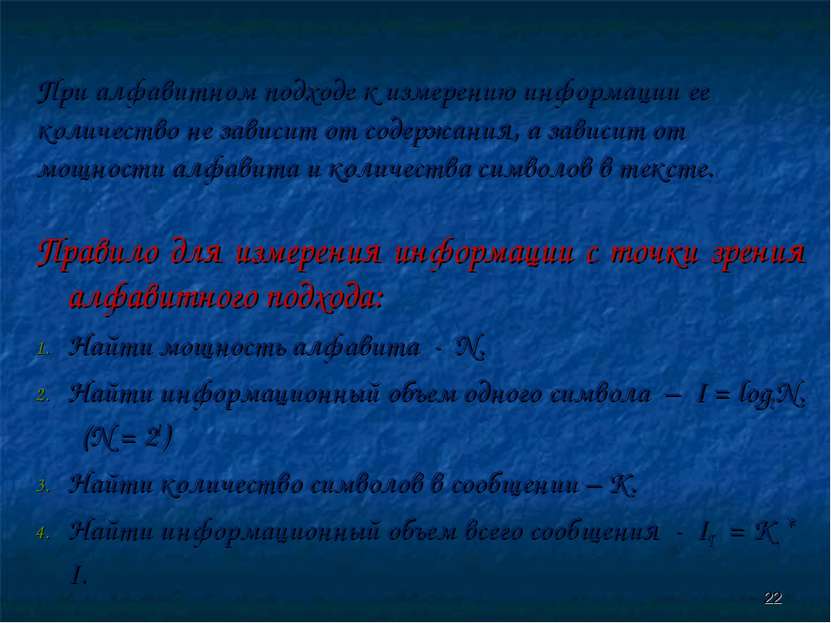

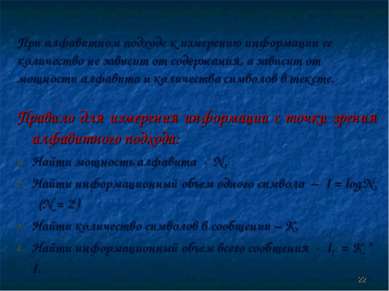

При алфавитном подходе к измерению информации ее количество не зависит от содержания, а зависит от мощности алфавита и количества символов в тексте. Правило для измерения информации с точки зрения алфавитного подхода: Найти мощность алфавита - N. Найти информационный объем одного символа – I = log2N. (N = 2I) Найти количество символов в сообщении – K. Найти информационный объем всего сообщения - IТ = K * I. *

При алфавитном подходе к измерению информации ее количество не зависит от содержания, а зависит от мощности алфавита и количества символов в тексте. Правило для измерения информации с точки зрения алфавитного подхода: Найти мощность алфавита - N. Найти информационный объем одного символа – I = log2N. (N = 2I) Найти количество символов в сообщении – K. Найти информационный объем всего сообщения - IТ = K * I. *

Cлайд 23

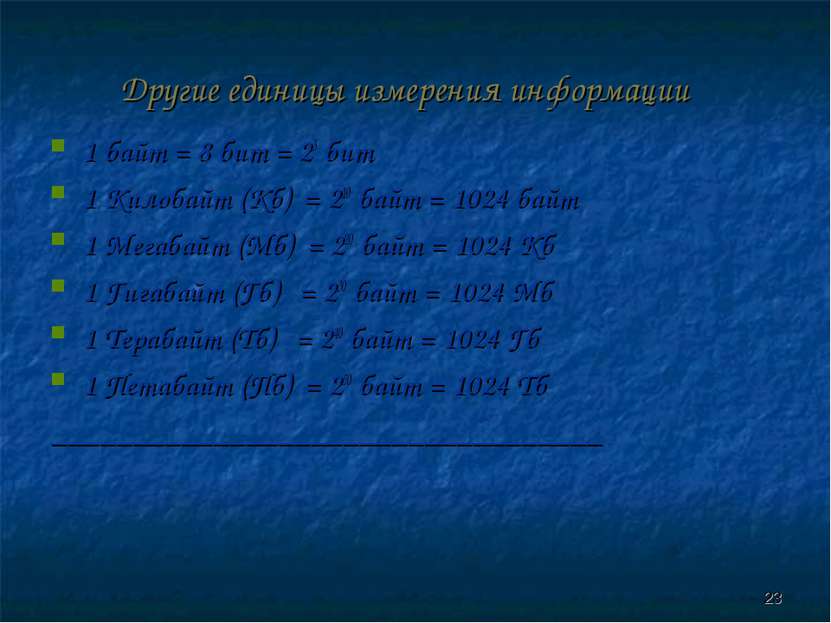

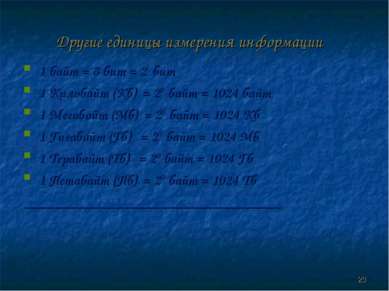

Другие единицы измерения информации 1 байт = 8 бит = 23 бит 1 Килобайт (Кб) = 210 байт = 1024 байт 1 Мегабайт (Мб) = 220 байт = 1024 Кб 1 Гигабайт (Гб) = 230 байт = 1024 Мб 1 Терабайт (Тб) = 240 байт = 1024 Гб 1 Петабайт (Пб) = 250 байт = 1024 Тб __________________________________ *

Другие единицы измерения информации 1 байт = 8 бит = 23 бит 1 Килобайт (Кб) = 210 байт = 1024 байт 1 Мегабайт (Мб) = 220 байт = 1024 Кб 1 Гигабайт (Гб) = 230 байт = 1024 Мб 1 Терабайт (Тб) = 240 байт = 1024 Гб 1 Петабайт (Пб) = 250 байт = 1024 Тб __________________________________ *

Cлайд 24

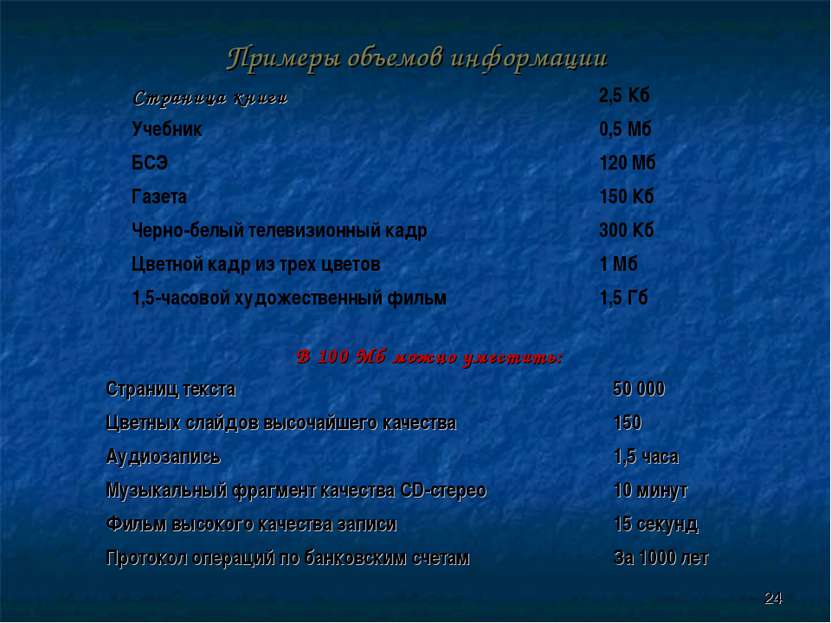

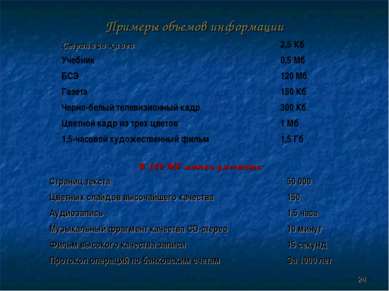

Примеры объемов информации * Страница книги 2,5 Кб Учебник 0,5 Мб БСЭ 120 Мб Газета 150 Кб Черно-белый телевизионный кадр 300 Кб Цветной кадр из трех цветов 1 Мб 1,5-часовой художественный фильм 1,5 Гб В 100 Мб можно уместить: Страниц текста 50 000 Цветных слайдов высочайшего качества 150 Аудиозапись 1,5 часа Музыкальный фрагмент качества CD-стерео 10 минут Фильм высокого качества записи 15 секунд Протокол операций по банковским счетам За 1000 лет

Примеры объемов информации * Страница книги 2,5 Кб Учебник 0,5 Мб БСЭ 120 Мб Газета 150 Кб Черно-белый телевизионный кадр 300 Кб Цветной кадр из трех цветов 1 Мб 1,5-часовой художественный фильм 1,5 Гб В 100 Мб можно уместить: Страниц текста 50 000 Цветных слайдов высочайшего качества 150 Аудиозапись 1,5 часа Музыкальный фрагмент качества CD-стерео 10 минут Фильм высокого качества записи 15 секунд Протокол операций по банковским счетам За 1000 лет

Cлайд 25

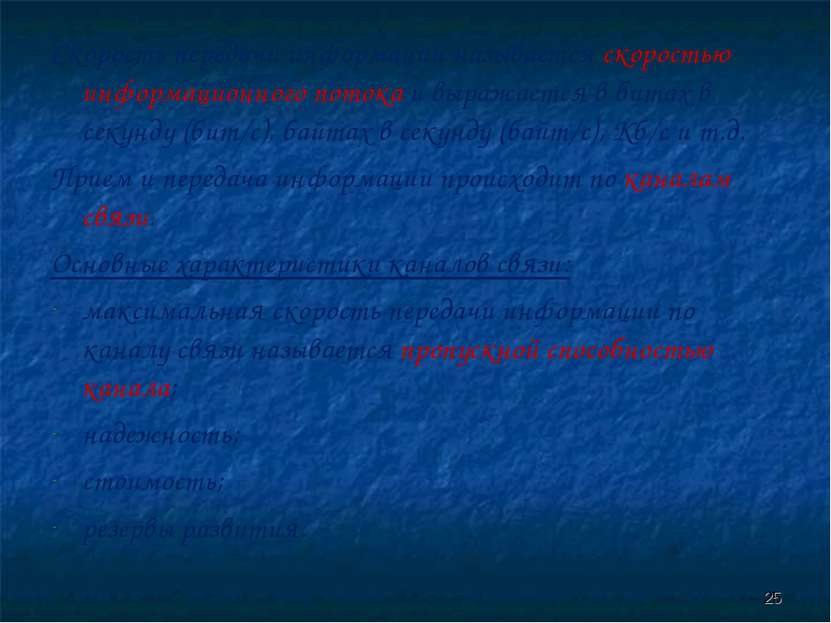

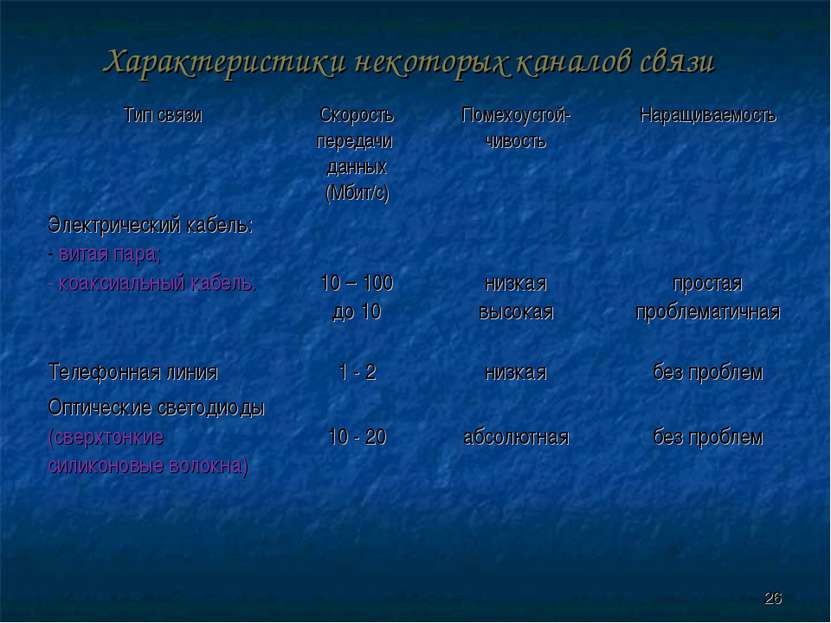

Скорость передачи информации называется скоростью информационного потока и выражается в битах в секунду (бит/с), байтах в секунду (байт/с), Кб/с и т.д. Прием и передача информации происходит по каналам связи. Основные характеристики каналов связи: максимальная скорость передачи информации по каналу связи называется пропускной способностью канала; надежность; стоимость; резервы развития. *

Скорость передачи информации называется скоростью информационного потока и выражается в битах в секунду (бит/с), байтах в секунду (байт/с), Кб/с и т.д. Прием и передача информации происходит по каналам связи. Основные характеристики каналов связи: максимальная скорость передачи информации по каналу связи называется пропускной способностью канала; надежность; стоимость; резервы развития. *

Cлайд 26

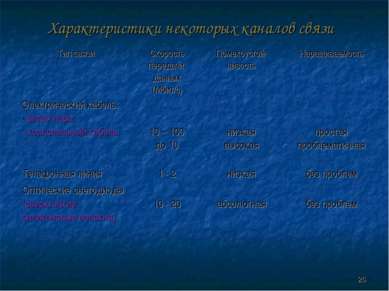

Характеристики некоторых каналов связи * Тип связи Скорость передачи данных (Мбит/с) Помехоустой-чивость Наращиваемость Электрический кабель: витая пара; коаксиальный кабель. 10 – 100 до 10 низкая высокая простая проблематичная Телефонная линия 1 - 2 низкая без проблем Оптические светодиоды (сверхтонкие силиконовые волокна) 10 - 20 абсолютная без проблем

Характеристики некоторых каналов связи * Тип связи Скорость передачи данных (Мбит/с) Помехоустой-чивость Наращиваемость Электрический кабель: витая пара; коаксиальный кабель. 10 – 100 до 10 низкая высокая простая проблематичная Телефонная линия 1 - 2 низкая без проблем Оптические светодиоды (сверхтонкие силиконовые волокна) 10 - 20 абсолютная без проблем